这是一个非常经典且实际的技术问题,对于 .NET 如果项目需要处理海量数据,接入 Hadoop 生态是绕不开的话题,下面我将从 为什么 .NET 开发者需要关注 Hadoop、核心技术方案、具体技术栈、实战场景 和 未来趋势 几个方面进行全面解析。

为什么 .NET 开发者需要关注 Hadoop?

Hadoop 生态系统是一个强大的分布式计算和存储平台,主要用于处理和存储超出单机处理能力的大规模数据集,对于 .NET 开发者而言,关注 Hadoop 的原因主要有:

- 企业级需求:许多大型企业(尤其是在金融、电商、电信、游戏等行业)的核心业务数据都存储在 Hadoop 集群上。.NET 团队需要参与这些核心业务的数据处理、报表分析或机器学习项目,就必须掌握与 Hadoop 交互的技术。

- 数据融合:企业的技术栈往往是混合的,可能后端服务是 .NET,而大数据平台是 Java 生态的 Hadoop。.NET 开发者需要能够将 .NET 应用程序中的数据写入 Hadoop,或者从 Hadoop 中读取数据供 .NET 应用使用。

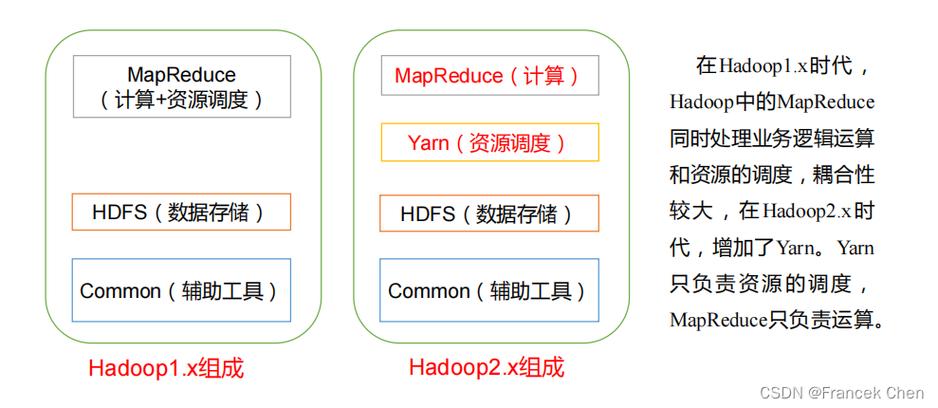

- 高性能计算:Hadoop 提供了 MapReduce、Spark 等计算框架,能够以并行方式处理 TB 甚至 PB 级的数据,对于需要复杂 ETL(提取、转换、加载)或批量数据处理任务的 .NET 应用,将其迁移到 Hadoop 上可以获得巨大的性能提升。

核心技术方案:.NET 如何与 Hadoop 交互?

.NET 开发者接入 Hadoop 生态主要有以下几种技术方案,它们各有优劣,适用于不同的场景:

| 方案 | 核心思想 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|

| Hadoop 连接器/客户端库 | 在 .NET 应用中引入 Java 依赖,通过 P/Invoke 或 JNI (Java Native Interface) 调用 Java 客户端库来与 Hadoop 服务通信。 | - 功能最全面:可以访问 HDFS、YARN、Hive、HBase 等几乎所有 Hadoop 组件。 - 生态成熟:基于稳定、广泛使用的 Java SDK。 |

- 依赖 JVM:需要在部署环境中安装和配置 Java 运行时。 - 部署复杂:依赖管理(如通过 IKVM)可能增加复杂性。 - 性能开销:.NET 与 JVM 之间的数据交互和转换有一定性能损耗。 |

需要在 .NET 应用(如 ASP.NET Core API, Windows Service, Console App)中实现对 Hadoop 的读写、查询等操作。 |

| REST API / WebHDFS | Hadoop 提供了基于 RESTful API 的接口(如 WebHDFS),允许任何能发送 HTTP 请求的语言与 HDFS 交互。 | - 跨平台、无依赖:纯 HTTP 通信,不依赖 Java。 - 简单直接:易于理解和使用,适合简单的文件操作。 |

- 功能有限:通常只支持 HDFS 的基本操作(上传、下载、列表、删除等),不直接支持 MapReduce 或复杂查询。 - 性能一般:HTTP 协议的开销比原生客户端大。 |

仅需对 HDFS 进行简单的文件上传、下载、管理等轻量级操作的场景。 |

| 将 .NET 代码提交到 Hadoop 集群运行 | 将 .NET 应用程序打包,并使用特定的工具将其提交到 Hadoop 集群上执行,利用集群的分布式资源。 | - 利用集群资源:能充分发挥 Hadoop 的分布式计算能力。 - 代码逻辑在 .NET 中:开发者可以使用熟悉的 C# 语言编写复杂的业务逻辑。 |

- 工具生态相对年轻:不如 Spark on Java 成熟。 - 学习曲线:需要理解 Hadoop 的资源调度模型。 |

需要将 .NET 中的计算逻辑(如 ETL 脚本、数据分析算法)分布式地在 Hadoop 集群上运行。 |

| 使用 .NET 的大数据计算框架 | 使用专门为 .NET 设计的、与 Hadoop 生态兼容的大数据计算框架。 | - 纯 .NET 体验:无需 Java 依赖,性能更好。 - 现代化 API:通常提供更简洁、类型安全的 API。 |

- 生态可能不如 Java 版本丰富:某些 Hadoop 特定组件的 .NET 支持可能不完整。 | 新建的大数据项目,或希望完全脱离 Java 依赖的 .NET 团队。 |

具体技术栈详解

方案 1 & 2:Hadoop 客户端与 REST API

这是最传统和最常见的方式,核心是 Apache Hadoop .NET SDK,它本质上是对 Java Hadoop 客户端的封装。

Apache Hadoop .NET SDK (通过 IKVM.NET)

-

原理:IKVM.NET 是一个在 .NET Framework 上运行 Java 程序的开源工具,它可以将 Java 的

.jar文件编译成.dll,使得 .NET 代码可以直接调用 Java 类库。 -

如何使用:

- 安装 IKVM。

- 使用 IKVM 的工具将 Hadoop 的客户端 JAR(如

hadoop-common,hadoop-hdfs)转换为 .NET DLL。 - 在你的 .NET 项目中引用这些生成的 DLL。

- 编写 C# 代码,调用这些 DLL 中的 Java 类,

org.apache.hadoop.fs.FileSystem来操作 HDFS。

-

示例代码 (概念性):

// 需要引用 IKVM 和转换后的 Hadoop DLL using org.apache.hadoop.conf; using org.apache.hadoop.fs; using org.apache.hadoop.fs.permission; // 配置 Hadoop 集地址 Configuration conf = new Configuration(); conf.set("fs.defaultFS", "hdfs://your-namenode:8020"); // 获取文件系统客户端 FileSystem fs = FileSystem.get(conf); // 执行操作,例如上传文件 Path localPath = new Path(@"C:\local\data.txt"); Path hdfsPath = new Path("/user/hadoop/data.txt"); fs.copyFromLocalFile(localPath, hdfsPath); Console.WriteLine("File uploaded successfully!"); fs.close(); -

现状:这种方式在 .NET Framework 时代很流行,但在 .NET Core/.NET 5+ 时代,由于 IKVM 对 .NET Core 的支持不佳,已逐渐被其他方案取代。

(图片来源网络,侵删)

(图片来源网络,侵删)

WebHDFS REST API

-

如何使用:使用 .NET 内置的

HttpClient或者更高级的IHttpClientFactory来发送 HTTP 请求。 -

示例代码 (使用 HttpClient):

using System; using System.Net.Http; using System.Threading.Tasks; using System.Text; public class HdfsService { private readonly HttpClient _httpClient; private readonly string _hdfsUrl; public HdfsService(string hdfsUrl) { _httpClient = new HttpClient(); _hdfsUrl = hdfsUrl; } public async Task UploadFileAsync(string localFilePath, string hdfsFilePath) { // 读取本地文件内容 byte[] fileContent = await System.IO.File.ReadAllBytesAsync(localFilePath); // 构造 WebHDFS REST API URL // op=CREATE&overwrite=true&data=true&permission=755 string url = $"{_hdfsUrl}/webhdfs/v1/{hdfsFilePath}?op=CREATE&overwrite=true"; // 第一次请求,获取上传位置 var response = await _httpClient.PutAsync(url, new ByteArrayContent(fileContent)); response.EnsureSuccessStatusCode(); Console.WriteLine("File uploaded via WebHDFS."); } } -

优点:简单,不依赖 Java,缺点是功能受限,且需要手动处理 Hadoop 的 Kerberos 认证(如果集群开启了),这比较复杂。

方案 3:在 Hadoop 上运行 .NET 代码

这个领域的代表是 Microsoft's .NET for Apache Spark。

- .NET for Apache Spark:

- 是什么:一个开源的、跨平台的 .NET 分布式数据处理引擎,它允许你使用 C# (F#) 编写 Spark 应用程序,并在 Apache Spark 集群上运行。

- 核心思想:它将你的 .NET 代码(通过 .NET Core Runtime)和依赖项打包,然后提交给 Spark 集群的 Executor,Spark 负责调度和分发计算任务,而每个 Executor 内部运行一个 .NET 环境来执行你的代码。

- 如何使用:

- 在你的 .NET 项目中安装

Microsoft.Spark.NETNuGet 包。 - 编写一个 `SparkSession

- 在你的 .NET 项目中安装