随着人工智能技术的飞速发展,AI识别技术已深度融入社会生产生活的方方面面,从人脸识别门禁、智能监控到医疗影像分析、自动驾驶等,其高效便捷的特性极大提升了社会运行效率,技术的广泛应用也引发了公众对隐私泄露的广泛担忧,如何在享受技术红利的同时守护个人隐私边界,成为当前亟待解决的重要议题。

AI识别技术是指通过计算机算法对图像、声音、文本等数据进行自动分析和处理,从而识别出特定信息或模式的技术,它以深度学习、计算机视觉、自然语言处理为核心,具备高效处理海量数据、精准识别复杂特征的优势,人脸识别技术可在1秒内完成身份核验,语音识别准确率已接近人类水平,这些特性使其在金融、安防、交通等领域迅速普及,据统计,2025年我国人脸识别市场规模突破600亿元,相关设备覆盖超过90%的地级市公共区域,技术的渗透率远超全球平均水平。

在技术落地的过程中,公众隐私风险主要体现在三个层面:一是数据采集的隐蔽性,部分AI设备在未明确告知用户的情况下,擅自采集人脸、声音等生物特征数据,甚至通过街边摄像头、手机APP等渠道进行“无感收集”,导致个人隐私在不知情中被泄露,二是数据存储的安全性,生物特征数据具有唯一性和不可更改性,一旦数据库被攻击或内部人员违规操作,可能引发大规模隐私泄露事件,2025年某知名企业人脸识别数据库泄露事件中,超500万条用户信息被非法售卖,对个人财产安全构成严重威胁,三是数据使用的随意性,部分机构将采集的数据用于商业营销、信用评估等未经用户授权的场景,甚至与第三方共享,形成“数据黑箱”,用户对自身数据的控制权被严重削弱。

AI识别技术与公众隐私的冲突本质上是技术效率与个人权利的平衡问题,从法律层面看,《中华人民共和国个人信息保护法》明确将生物识别信息列为敏感个人信息,要求处理者取得个人单独同意,并采取严格保护措施,但在实际执行中,仍存在“告知同意”流于形式、监管滞后于技术发展等问题,部分小区强制推行人脸识别门禁,将“不刷脸就无法进入”作为唯一选项,变相剥夺了业主的选择权;一些景区通过人脸识别入园后,将游客画像数据用于旅游线路推荐,超出了“入园管理”的原始目的。

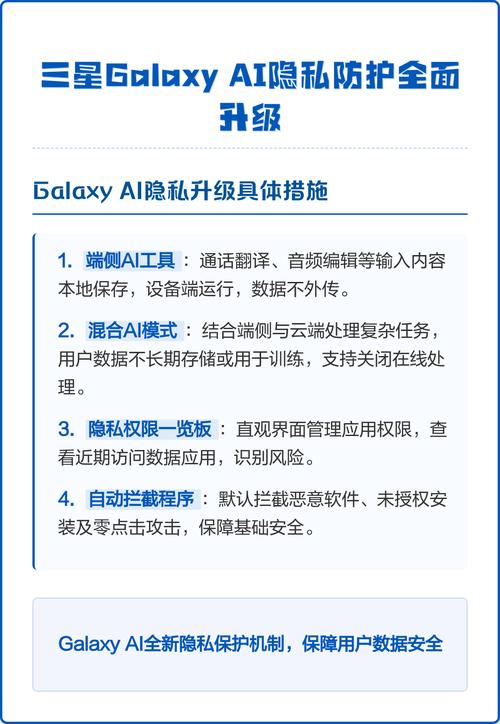

为推动技术健康发展,需构建“技术+法律+行业”的多维治理体系,在技术层面,应推广“隐私增强技术”(PETs),如差分隐私、联邦学习等,在数据分析阶段对个人信息进行脱敏处理,确保原始数据不可逆;同时开发“可解释AI”模型,让用户清晰了解数据被如何使用、识别结果如何产生,在法律层面,需细化行业标准和处罚细则,明确数据采集的“最小必要原则”,禁止过度收集;建立独立的第三方审计机构,对企业的数据处理活动进行常态化监督,在行业层面,企业应履行主体责任,建立用户数据授权撤回机制,定期公开隐私保护报告,接受社会监督。

公众自身也需提升隐私保护意识,在享受AI服务时主动阅读隐私条款,对非必要的数据采集 say no;发现隐私侵权行为时,可通过12315、网信办举报平台等渠道维权,只有当技术发展与权利保障同步推进,AI识别技术才能真正成为提升公众福祉的工具,而非侵蚀隐私的“利器”。

相关问答FAQs

Q1:AI识别技术是否会100%准确识别个人身份?是否存在误判风险?

A1:AI识别技术并非100%准确,其识别率受数据质量、算法模型、环境因素等影响,人脸识别在光线不足、面部遮挡(如口罩、墨镜)或角度偏差时,误识率可能上升至1%-5%,远高于指纹识别的0.01%,多模态识别(结合人脸、声纹、步态等多维度信息)可有效降低误判率,但技术局限性仍存在,需结合人工复核确保关键场景的准确性。

Q2:如果发现个人隐私被AI识别技术侵犯,应该如何维权?

A2:保留证据如侵权截图、设备采集记录等;向侵权方提出书面异议,要求删除个人信息、停止侵权;若协商无果,可向网信部门、市场监管部门投诉,或通过法律途径起诉,根据《个人信息保护法》,侵权方需承担民事赔偿(如精神损害抚慰金)及行政处罚,情节严重者可能面临吊销营业执照等处罚。