计算机技术的主要技术是推动现代社会数字化转型的核心驱动力,涵盖了从硬件基础到软件应用、从数据处理到网络通信的多个维度,这些技术相互交织、协同发展,共同构建了现代信息社会的技术基石,以下从核心领域、关键技术及发展趋势等方面进行详细阐述。

计算机技术的核心首先体现在硬件体系结构上,以冯·诺依曼体系为基础的计算机硬件,由运算器、控制器、存储器、输入设备和输出设备五大部件组成,中央处理器(CPU)作为“大脑”,负责执行指令和处理数据,其性能提升依赖于制程工艺的进步(如从7nm向3nm演进)和架构创新(如ARM的能效优化与x86的高性能设计),存储技术方面,从DRAM的动态随机存取到NAND闪存的非易失性存储,再到新兴的存储级内存(SCM),解决了速度与成本的平衡问题,而GPU(图形处理器)通过并行计算架构,在人工智能训练、科学计算等领域展现出强大算力,成为继CPU后的另一核心硬件。

操作系统是计算机技术的“灵魂”,负责管理硬件资源并为用户提供交互界面,从早期的批处理系统到现代的多任务、分时操作系统(如Windows、Linux、macOS),其核心功能包括进程调度、内存管理、文件系统和设备驱动,Linux凭借开源特性,在服务器、嵌入式系统和超级计算机领域占据主导地位;而实时操作系统(RTOS)则在工业控制、汽车电子等对响应时间要求严苛的场景中不可或缺,容器化技术(如Docker、Kubernetes)通过轻量级虚拟化,实现了应用环境的标准化和高效部署,推动了云计算和微服务架构的发展。

编程语言与软件开发方法是计算机技术的“血肉”,从机器语言、汇编语言到高级语言(如Python、Java、C++),编程语言的演进降低了开发门槛,提升了代码可读性和复用性,Python因简洁的语法和丰富的库生态(如NumPy、TensorFlow),成为数据科学与人工智能领域的首选语言;Java则凭借“一次编写,到处运行”的跨平台特性,在企业级应用中占据重要地位,软件开发方法也从传统的瀑布模型迭代到敏捷开发、DevOps,强调快速迭代、持续集成与交付,缩短了开发周期并提升了软件质量。

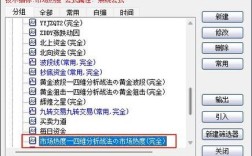

数据管理技术是计算机技术的“核心资产”,数据库管理系统(DBMS)实现了数据的结构化存储与高效查询,从关系型数据库(如MySQL、Oracle)到NoSQL数据库(如MongoDB、Redis),再到NewSQL数据库(如Google Spanner),以适应不同场景的需求(如高并发、海量数据、强一致性),大数据技术则通过分布式存储(如HDFS)和计算框架(如MapReduce、Spark),解决了PB级数据的处理问题,支撑了数据分析、数据挖掘等应用,数据仓库与数据湖的兴起,进一步整合了多源数据,为商业智能(BI)和人工智能提供了数据基础。

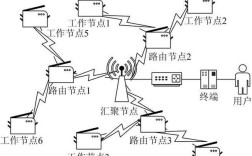

网络与通信技术是计算机技术的“神经网络”,互联网协议(TCP/IP)作为全球通信的基石,实现了异构网络的互联互通,5G技术的低延迟、高带宽特性,推动了物联网(IoT)、车联网等应用的发展;而Wi-Fi 6/6E则提升了无线局域网的容量和效率,网络安全技术,包括防火墙、入侵检测系统(IDS)、加密算法(如AES、RSA)等,保障了数据传输和存储的安全性,区块链技术通过去中心化、不可篡改的特性,在数字货币、供应链金融等领域展现出应用潜力。

人工智能(AI)与机器学习(ML)是当前计算机技术的前沿方向,深度学习通过神经网络模型(如CNN、RNN、Transformer),在图像识别、自然语言处理(NLP)等领域取得突破性进展,强化学习在游戏AI(如AlphaGo)、自动驾驶决策系统中展现出强大的学习能力,边缘计算将AI计算从云端下沉到设备端,降低了延迟并提升了隐私保护能力,生成式AI(如GPT系列、DALL-E)通过大规模预训练模型,实现了文本生成、图像创作等创造性任务,正在重塑内容生产方式。

量子计算作为未来计算机技术的重要方向,利用量子叠加和纠缠特性,有望在密码破解、药物研发等复杂问题中实现指数级加速,尽管目前仍处于早期阶段,但IBM、Google等企业已推出量子处理器原型,推动量子比特数量和稳定性的提升。

云计算与边缘计算的协同发展,构成了“云-边-端”一体化架构,云计算提供弹性计算资源和存储服务(如IaaS、PaaS、SaaS),降低了企业IT成本;边缘计算则在靠近数据源的设备端进行实时处理,满足物联网等场景的低延迟需求,两者结合,实现了资源的最优分配和高效利用。

计算机技术的未来发展将呈现智能化、泛在化、绿色化等趋势,AI与各领域的深度融合将推动智能交通、智慧医疗、智能制造等应用的普及;6G、脑机接口等新兴技术将进一步拓展人机交互的边界,随着算力需求的激增,绿色计算(如低功耗芯片、液冷技术)将成为重要研究方向,以降低能耗和碳排放。

| 技术领域 | 关键技术 | 应用场景举例 |

|---|---|---|

| 硬件体系结构 | CPU/GPU架构、存储技术、量子计算 | 高性能计算、数据中心、AI训练 |

| 操作系统 | 通用操作系统、实时操作系统、容器化技术 | 服务器管理、工业控制、微服务部署 |

| 编程语言与开发 | 高级语言(Python/Java)、敏捷开发、DevOps | 软件开发、数据科学、自动化运维 |

| 数据管理 | 数据库(SQL/NoSQL)、大数据技术、数据仓库 | 商业智能、数据分析、金融风控 |

| 网络与通信 | 5G/6G、TCP/IP、网络安全、区块链 | 物联网、远程办公、数字货币 |

| 人工智能 | 深度学习、强化学习、生成式AI、边缘AI | 自动驾驶、医疗影像、智能客服 |

相关问答FAQs:

-

问:计算机技术中,AI与传统软件开发的区别是什么?

答:传统软件开发基于明确的规则和逻辑,通过编写代码实现特定功能;而AI(尤其是机器学习)通过数据训练模型,从数据中学习规律并实现预测或决策,传统软件的输出是确定的,而AI的输出具有概率性,且性能依赖数据质量和算法优化,AI开发更注重数据预处理、模型训练和调参,而非单纯的代码编写。 -

问:为什么量子计算被认为是未来计算机技术的重要方向?

答:量子计算利用量子比特的叠加和纠缠特性,可以同时处理多种状态,在解决特定问题(如大数分解、复杂系统模拟)时具有指数级的计算优势,Shor算法可破解现有RSA加密,量子模拟可加速新药研发,尽管当前量子计算机面临量子退相干、错误率高等挑战,但其潜力使其在密码学、材料科学、人工智能等领域具有革命性应用前景。