基于遗传算法的神经网络是一种将生物进化原理与人工神经网络相结合的优化方法,旨在通过模拟自然选择和遗传机制自动优化神经网络的拓扑结构、连接权重及其他超参数,传统神经网络依赖梯度下降等局部优化算法,易陷入局部最优且对初始参数敏感,而遗传算法作为一种全局优化工具,能够通过种群进化策略探索更广阔的解空间,从而提升神经网络的性能和泛化能力,本文将从基本原理、核心步骤、优势挑战、应用场景及未来方向等方面展开详细阐述。

基本原理与核心思想

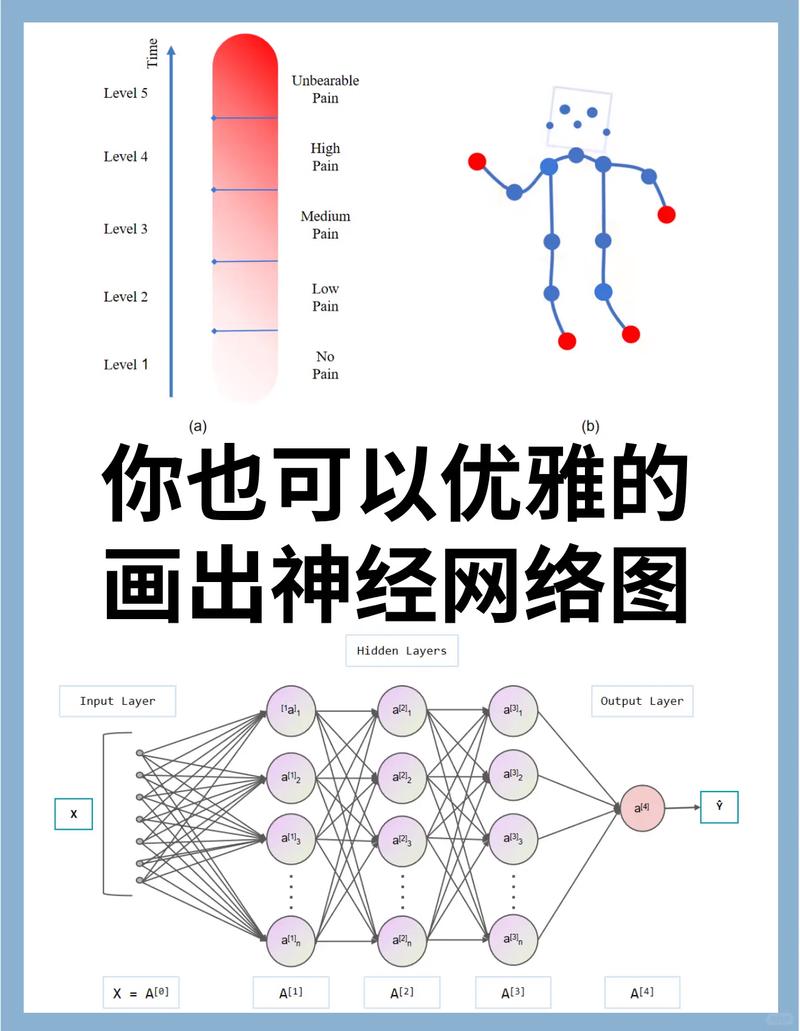

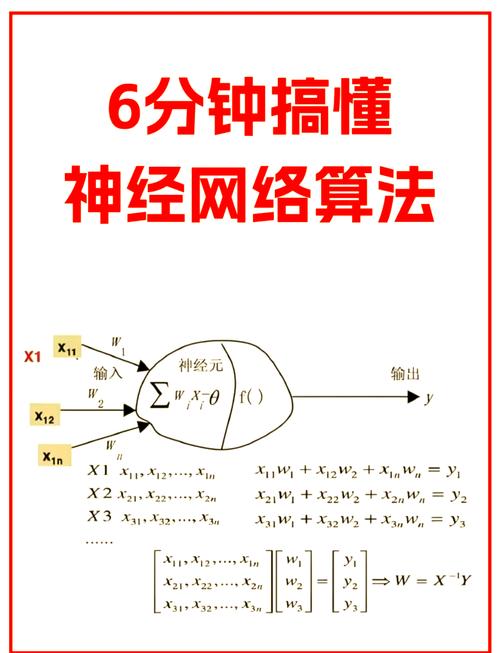

遗传算法(Genetic Algorithm, GA)源于达尔文进化论,通过选择、交叉、变异等操作迭代优化种群适应度,神经网络(Neural Network, NN)则是由大量神经元相互连接而成的非线性模型,其性能取决于网络结构(如层数、神经元数量)和连接权重,基于遗传算法的神经网络核心思想是将神经网络的设计问题转化为一个优化问题:将神经网络的拓扑结构、权重等参数编码为“染色体”,通过遗传算法的进化操作寻找适应度最高的“个体”,即最优神经网络模型。

神经网络的权重可直接编码为实数染色体,而结构优化(如动态增减神经元或层数)则可采用二进制编码或树状结构编码,适应度函数则根据任务目标设计,如分类准确率、回归误差、网络复杂度(以避免过拟合)等,通过多代进化,算法逐步淘汰低性能个体,保留并重组高性能个体的特征,最终逼近全局最优解。

核心实现步骤

基于遗传算法的神经网络优化通常包含以下关键步骤:

编码(Encoding)

编码是将神经网络的结构和参数转化为遗传算法可处理的染色体形式,常见编码方式包括:

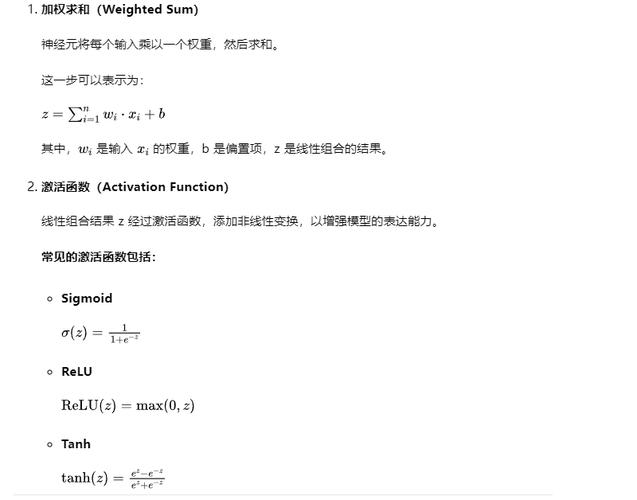

- 实数编码:直接将神经网络权重或偏置作为染色体基因,适用于权重优化,精度高但搜索空间大。

- 二进制编码:将基因表示为0/1串,适用于结构优化(如神经元是否存在),便于交叉操作但可能存在“海明 cliff”问题。

- 树状编码:用于表示网络拓扑结构(如卷积核大小、层数组合),灵活性高但交叉和变异操作复杂。

以一个简单的全连接神经网络为例,若其权重矩阵为W(输入层到隐藏层)和V(隐藏层到输出层),则染色体可表示为[W; V]的实数向量。

初始化种群

随机生成一组初始染色体(即一组随机神经网络),构成初始种群,种群大小影响算法的搜索效率和多样性,通常为50-200,为避免过早收敛,初始种群需具备足够的随机性。

适应度评估

根据任务目标计算每个染色体(神经网络)的适应度值,适应度函数是算法进化的导向,需兼顾性能与效率。

- 分类任务:适应度 = 准确率 - λ·网络参数量(λ为惩罚系数,避免过复杂模型)。

- 回归任务:适应度 = 1 / (MSE + ε)(ε为极小值,防止分母为零)。

选择操作

根据适应度值从当前种群中选择优秀个体作为父代,选择概率通常与适应度正相关,常见方法包括:

- 轮盘赌选择:个体被选中的概率与其适应度占比成正比,简单但可能使高适应度个体过度主导。

- 锦标赛选择:随机选取k个个体,适应度最高者被选中,参数k通常为2-5,平衡选择压力与多样性。

交叉与变异

通过交叉和变异操作生成子代个体,保持种群多样性并探索新解:

- 交叉:将两个父代染色体的部分基因交换,生成新个体,实数编码可采用算术交叉(子代基因 = α·父代1 + (1-α)·父代2),二进制编码采用单点或多点交叉。

- 变异:以小概率随机改变染色体中的某些基因,如权重扰动(±随机小量)或结构基因翻转(0变1,表示新增神经元),变异概率通常为0.001-0.1,过高会导致随机性过强,过低则可能陷入局部最优。

终止条件与迭代

当满足预设终止条件时停止进化,否则重复选择、交叉、变异步骤,终止条件包括:达到最大迭代次数(如100-500代)、适应度收敛(连续多代适应度提升小于阈值)或计算资源耗尽,最终输出种群中适应度最高的个体作为优化后的神经网络模型。

优势与挑战

优势

- 全局优化能力:遗传算法通过种群搜索避免梯度下降的局部最优问题,尤其适用于非凸、多峰的神经网络优化场景。

- 自动化设计:可同时优化网络结构和参数,减少人工调参成本,通过进化自动确定神经网络的层数、神经元数量或激活函数类型。

- 鲁棒性:对初始参数不敏感,且通过交叉和变异操作可有效跳出局部最优,适用于复杂任务(如高维数据分类)。

挑战

- 计算开销大:每个个体需完整训练或评估一次神经网络,种群规模和迭代次数导致计算成本远高于传统方法。

- 编码设计复杂:结构优化时需设计合理的编码方式,避免染色体过长或无效解(如不连通的网络结构)。

- 超参数敏感:遗传算法自身的参数(如种群大小、变异概率)需调整,且不同任务的最优参数差异较大。

应用场景

基于遗传算法的神经网络已在多个领域展现应用价值:

- 图像识别:优化卷积神经网络(CNN)的结构,如自动搜索卷积核大小、层数组合,提升ImageNet等数据集的分类精度。

- 机器人控制:进化神经网络的连接权重,使机器人适应复杂环境,如路径规划或机械臂动作优化。

- 金融预测:结合时间序列数据和神经网络,进化优化LSTM或GRU的结构参数,提高股票价格预测的准确性。

- 医疗诊断:优化深度学习模型的特征提取层,结合医学影像数据(如CT、MRI)提升疾病分类的鲁棒性。

未来发展方向

- 混合优化策略:将遗传算法与梯度下降结合,如先用GA优化网络结构,再用BP算法训练权重,兼顾全局搜索与局部精调。

- 并行计算加速:利用GPU或分布式计算平台并行评估种群个体,降低计算开销。

- 自适应遗传算法:动态调整交叉概率、变异概率等参数,根据进化进程平衡探索与开发能力。

- 与强化学习结合:用于优化强化学习中策略网络的参数和结构,解决高维状态空间下的决策问题。

相关问答FAQs

Q1:基于遗传算法的神经网络与传统梯度下降法优化神经网络的主要区别是什么?

A1:核心区别在于优化策略和全局搜索能力,传统梯度下降法依赖目标函数的梯度信息,通过迭代更新权重沿局部最优方向收敛,但易陷入局部最优且对初始值敏感;而遗传算法模拟生物进化,通过种群搜索和随机操作(交叉、变异)探索全局解空间,不依赖梯度信息,适用于非凸优化问题,GA可同时优化网络结构和参数,而梯度下降通常仅优化权重,但GA的计算成本更高,收敛速度较慢。

Q2:如何解决基于遗传算法的神经网络计算开销大的问题?

A2:可通过以下方法降低计算开销:(1)种群规模优化:采用自适应种群大小策略,在进化早期使用较大种群探索,后期缩小种群以加速收敛;(2)并行计算:利用GPU或多进程并行评估个体适应度,如Python的multiprocessing库或分布式框架;(3)简化适应度评估:在训练早期采用部分数据或简化模型评估适应度,后期再使用完整数据;(4)增量学习:对子代个体继承父代的部分训练结果,减少重复计算,这些方法可在保证优化效果的前提下显著提升效率。