高性能计算并行编程技术是解决大规模科学计算、工程模拟和数据处理等问题的关键手段,通过将复杂任务分解为多个子任务,利用多处理器、多核CPU或分布式系统的协同计算能力,显著提升计算效率,随着数据量的爆炸式增长和计算需求的复杂化,并行编程技术已成为高性能计算领域的核心支撑,其发展直接决定了计算能力的天花板。

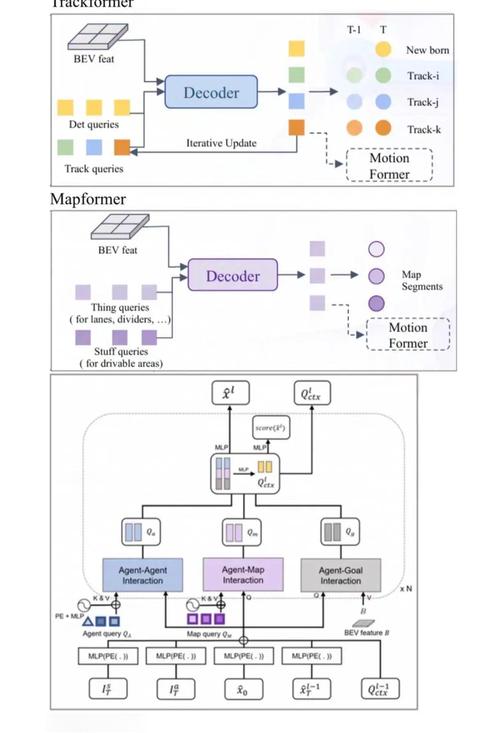

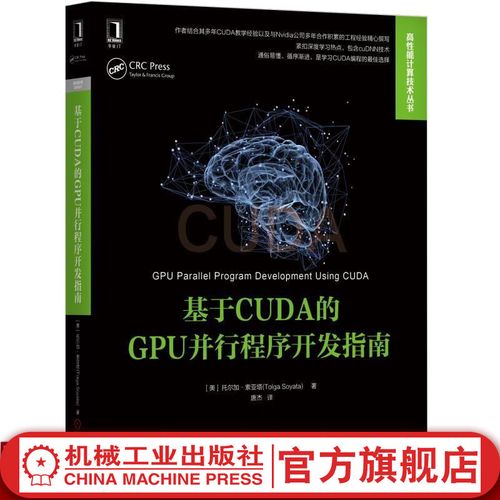

并行编程技术的核心思想是通过任务分解和资源调度实现计算加速,根据计算模型的不同,主要分为共享内存并行和分布式内存并行两大类,共享内存并行如OpenMP和Pthread,通过多线程共享同一物理内存空间,线程间通信开销小,适合细粒度并行任务,但可扩展性受限于内存带宽和一致性协议,分布式内存并行如MPI(Message Passing Interface),则通过节点间显式消息传递实现数据交换,适用于大规模集群系统,可扩展性强,但编程复杂度高,需手动处理数据分片和通信同步,异构并行技术如CUDA和OpenCL,利用GPU等加速器的并行计算能力,通过核函数编程实现CPU与GPU的协同计算,在深度学习、图像处理等领域展现出显著优势。

在实际应用中,并行编程技术的选择需综合考虑问题特性、硬件架构和性能需求,气候模拟等需要大规模数据交换的任务通常采用MPI进行分布式并行,而分子动力学模拟等依赖局部数据交互的任务则更适合OpenMP共享内存并行,近年来,混合并行模型逐渐成为主流,如MPI+OpenMP组合,既利用分布式内存的扩展性,又发挥共享内存的通信效率,同时结合GPU异构计算,形成多层次并行架构,任务并行和数据并行的结合进一步优化了资源利用率,如Hadoop和Spark等框架通过数据分片和任务调度实现分布式数据处理,适用于大数据分析场景。

并行编程的性能优化涉及算法设计、代码实现和系统调优多个层面,算法层面需确保任务划分的负载均衡,避免计算热点和通信瓶颈;代码层面需减少同步开销,优化数据局部性,如循环展开、向量化等技术;系统层面则需结合硬件特性调整线程数、块大小等参数,充分利用缓存和内存带宽,以矩阵乘法为例,传统实现需三层嵌套循环,通过循环分块技术可提升缓存命中率,而采用MPI并行时,需合理划分数据块以减少节点间通信量,结合GPU加速则可进一步利用CUDA的并行核函数实现数倍加速。

相关问答FAQs:

-

问:并行编程中共享内存和分布式内存的优缺点分别是什么?

答:共享内存并行(如OpenMP)的优点是编程模型简单,线程间通信开销小,适合细粒度任务;缺点是可扩展性受限,受限于内存带宽和一致性协议,节点数量增加时性能下降,分布式内存并行(如MPI)的优点是可扩展性强,适用于大规模集群,节点间独立内存避免竞争;缺点是编程复杂,需手动处理数据分片和消息传递,通信开销较大。 -

问:如何选择合适的并行编程模型?

答:选择需基于问题特性和硬件架构:若任务数据依赖性强、交互频繁,且硬件为多核CPU,可选共享内存模型(如OpenMP);若任务可分解为独立子任务,需跨节点扩展,适合分布式内存模型(如MPI);若涉及GPU加速,可采用CUDA或OpenCL实现异构并行;对于混合场景,如多节点多核+GPU,建议采用MPI+OpenMP+CUDA的混合模型以兼顾效率和扩展性。