NVIDIA CUDA技术是一种革命性的并行计算平台和编程模型,由NVIDIA公司于2006年推出,它赋予了GPU(图形处理器)强大的通用计算能力,彻底改变了计算领域的发展格局,在CUDA出现之前,GPU主要用于图形渲染,其架构虽然具备高并行度,但难以直接用于科学计算、数据分析等通用任务,CUDA通过提供硬件架构、软件编程接口、编译器、驱动程序以及开发工具包等完整的生态系统,使得开发者能够利用C/C++等主流编程语言,在GPU上高效执行复杂的并行计算任务,从而释放出GPU的巨大计算潜力。

CUDA技术的核心在于其硬件架构和软件设计的紧密结合,从硬件层面看,现代NVIDIA GPU基于CUDA Core架构,包含大量流处理器(Streaming Multiprocessors, SMs),每个SM又拥有多个CUDA Core,这种大规模并行架构使得GPU能够同时处理数千个线程,非常适合执行数据并行型任务,在深度学习中,神经网络的前向传播和反向传播涉及大量矩阵运算,这些运算可以被分解为无数个独立的乘加操作,由GPU的CUDA Core同时执行,从而实现比CPU快几个数量级的计算速度,GPU还配备了高速显存(如GDDR6),能够提供更大的带宽和容量,满足大规模数据集的存储和访问需求。

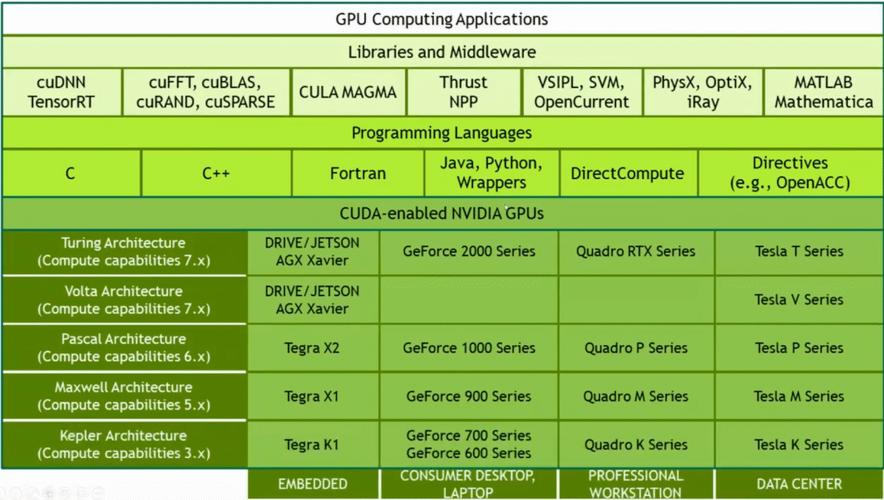

软件层面,CUDA采用单源编程模型,开发者可以在同一个代码文件中使用C/C++语言编写主机端(CPU)代码和设备端(GPU)代码,主机代码负责控制程序流程、数据传输和任务调度,而设备代码则以CUDA Kernel(内核函数)的形式在GPU上执行,Kernel函数是GPU并行计算的基本单元,当调用Kernel时,GPU会创建大量的线程来执行该函数,这些线程被组织成线程块(Thread Blocks),线程块又被组织成线程网格(Grid),这种层次化的线程结构使得CUDA能够灵活地处理不同规模和复杂度的并行任务,CUDA提供了丰富的库函数,如用于线性代数运算的cuBLAS、用于傅里叶变换的cuFFT、用于深度学习的cuDNN等,这些库经过高度优化,能够显著简化开发流程并提升计算效率。

CUDA技术的应用领域极为广泛,几乎涵盖了所有需要高性能计算的行业,在人工智能领域,CUDA是深度学习框架(如TensorFlow、PyTorch)的底层计算引擎,支撑着图像识别、自然语言处理、自动驾驶等前沿技术的发展,训练一个大型语言模型需要进行数万亿次浮点运算,借助GPU的并行计算能力,训练时间可以从数月缩短至数天甚至数小时,在科学计算领域,CUDA被广泛应用于流体力学模拟、分子动力学、气候建模等任务,这些任务通常涉及庞大的计算量和复杂的数据依赖关系,GPU的并行架构能够有效加速求解过程,在数据分析与可视化领域,CUDA能够加速大规模数据集的排序、过滤、聚类等操作,以及实时渲染复杂的3D图形,提升用户体验,在金融分析、医学影像、密码学等领域,CUDA也发挥着重要作用,帮助用户快速完成复杂的计算任务。

为了更直观地展示CPU与GPU在架构和性能上的差异,以下是一个简单的对比表格:

| 特性 | CPU (中央处理器) | GPU (图形处理器,基于CUDA技术) |

|---|---|---|

| 核心数量 | 较少(通常为几核至几十核) | 极多(通常为数千核) |

| 架构设计 | 低延迟、高复杂度,擅长串行任务和逻辑控制 | 高吞吐、高并行度,擅长数据并行任务 |

| 缓存大小 | 较大的L1/L2/L3缓存,减少内存访问延迟 | 相对较小的缓存,但更高的内存带宽 |

| 内存访问模式 | 随机访问能力强 | 更适合连续、批量数据访问 |

| 典型应用场景 | 操作系统、通用计算、复杂逻辑处理 | 图形渲染、深度学习、科学计算、大规模数据并行 |

| 功耗效率 | 单核功耗高,总功耗相对较低 | 单核功耗低,总功耗较高,但计算效率更高 |

CUDA技术的成功离不开其完善的生态系统和开发工具链,NVIDIA提供了CUDA Toolkit,其中包含了CUDA编译器(nvcc)、调试器(cuda-gdb)、性能分析器(Nsight)以及各种优化库,开发者可以通过这些工具轻松地将现有代码移植到GPU平台,或者开发新的并行应用程序,NVIDIA还推出了CUDA-X AI加速库,涵盖深度学习、机器学习、数据分析等多个领域,为不同应用场景提供定制化的优化方案,随着GPU硬件的不断升级(如从Pascal、Volta、Ampere到最新的Hopper架构),CUDA技术也在持续演进,支持更先进的计算特性(如张量核心、光线追踪技术等),进一步拓展了其应用边界。

尽管CUDA技术具有显著优势,但在使用过程中也面临一些挑战,GPU编程需要开发者具备并行计算思维,理解线程层次结构和内存模型,这比传统CPU编程更为复杂,数据传输开销(CPU与GPU之间的数据拷贝)也可能成为性能瓶颈,因此需要合理设计数据布局和传输策略,为了解决这些问题,NVIDIA提供了丰富的教程、文档和社区支持,帮助开发者快速掌握CUDA编程技巧,随着异构计算(CPU+GPU协同工作)理念的普及,CUDA也在不断优化与CPU的协同效率,实现计算资源的最优配置。

相关问答FAQs:

-

问:CUDA技术是否只能在NVIDIA的GPU上使用?

答:是的,CUDA技术是NVIDIA的专有技术,只能在NVIDIA的GPU硬件上运行,这是因为CUDA的底层架构和优化是针对NVIDIA GPU的流处理器和显存系统设计的,NVIDIA提供了广泛的GPU产品线,从消费级的GeForce系列到数据中心的Tesla系列,都支持CUDA技术,覆盖了从个人开发到大规模商业应用的不同需求。 (图片来源网络,侵删)

(图片来源网络,侵删) -

问:学习CUDA编程需要具备哪些基础知识?

答:学习CUDA编程需要具备以下基础知识:掌握C/C++编程语言,因为CUDA是基于C/C++扩展的,熟悉指针、内存管理、函数等概念是必要的;了解基本的并行计算思想,如数据并行、任务并行等;对计算机体系结构(如内存层次、缓存机制)和GPU硬件架构(如线程块、网格)有初步认识会更有帮助,NVIDIA官方提供了免费的CUDA教程和文档,初学者可以通过这些资源逐步入门。