AI芯片图像增强技术是人工智能硬件与视觉处理领域交叉融合的核心方向,通过专用芯片架构与算法协同优化,实现对图像实时、高效、高质量的增强处理,广泛应用于安防监控、自动驾驶、医疗影像、消费电子等场景,其技术本质是将传统图像增强算法(如去噪、超分辨率、色彩校正等)与AI模型(如深度神经网络)相结合,并依托芯片的并行计算能力、低功耗设计及专用硬件加速单元,实现从软件依赖向硬件级性能突破的跨越。

技术原理与核心架构

AI芯片图像增强技术的核心在于“算法-硬件”协同设计,通过专用芯片架构高效运行深度学习模型,解决传统图像处理中计算效率低、依赖人工参数调整等问题,其技术原理可拆解为三个层面:

算法层:深度学习模型驱动

传统图像增强依赖手工设计特征(如滤波器、变换矩阵),而AI技术以数据驱动为核心,通过卷积神经网络(CNN)、生成对抗网络(GAN)、Transformer等模型学习图像的内在规律。

- 超分辨率:SRCNN、EDSR等模型通过低分辨率-高分辨率图像对训练,学习图像的高频细节特征,实现从模糊到清晰的重建;

- 去噪与修复:DnCNN网络通过残差学习分离噪声与干净图像,GAN则通过生成器与判别器的对抗训练,修复图像中的缺失区域;

- 动态范围调整:基于Retinex理论的AI模型(如Zero-DCE)通过学习场景光照分布,压缩高动态范围图像(HDR)至标准动态范围(SDR),同时保留暗部与亮部细节。

这些模型的共同特点是参数量大、计算复杂度高,需依赖芯片的并行计算能力实现实时处理。

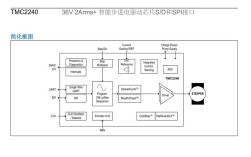

芯片层:专用硬件加速架构

AI芯片通过定制化硬件设计,针对图像增强算法的运算特点(如大量矩阵乘法、卷积操作、激活函数计算)进行优化,核心架构包括:

- 并行计算单元:如NVIDIA的Tensor Core、华为昇腾的AI Core,采用脉动阵列(Systolic Array)设计,实现矩阵乘法的硬件级并行,提升计算吞吐量;

- 低精度计算支持:通过INT8/INT4等低精度量化技术,减少数据存储带宽与功耗,同时保持模型精度(如TensorRT-Tools支持的量化加速);

- 片上存储优化:集成大容量SRAM或HBM(高带宽内存),减少数据搬运延迟,满足图像处理中“高带宽、低延迟”的需求;

- 专用指令集:针对卷积、池化、激活等操作设计硬件指令(如寒武纪的MLU指令集),避免CPU通用指令的开销。

以安防监控场景为例,4K@30fps的图像增强需处理约120MB/s的数据流,传统CPU方案难以满足实时性要求,而专用AI芯片可通过并行计算将处理延迟压缩至10ms以内。

软件层:工具链与模型优化

芯片需配套完整的软件工具链,实现从模型训练到部署的全流程优化:

- 模型压缩:通过剪枝(Pruning)、量化(Quantization)、知识蒸馏(Knowledge Distillation)等技术,减少模型计算量,适配芯片资源限制;

- 算子融合:将多个连续的算子(如卷积+ReLU+池化)融合为单一硬件操作,减少内核调用开销;

- 编译优化:通过AI编译器(如NVIDIA TensorRT、TensorFlow Lite)将模型映射至芯片硬件架构,自动优化内存访问与计算调度。

关键技术突破与应用场景

AI芯片图像增强技术的突破点在于解决“实时性”“能效比”与“泛化性”的矛盾,推动技术从实验室走向规模化应用。

实时性突破:边缘计算与端侧部署

传统图像增强依赖云端服务器,存在高延迟、隐私泄露等问题,AI芯片通过边缘计算能力,将处理能力下沉至终端设备(如摄像头、手机、汽车)。

- 安防监控:海康威视基于自研AI芯片“昆仑”,实现4K视频实时去噪与超分辨率,夜间监控清晰度提升60%以上;

- 自动驾驶:特斯拉FSD芯片通过神经网络引擎,实时增强摄像头图像,识别距离从传统方案的50米提升至150米,提升行车安全性;

- 消费电子:华为手机搭载的麒麟芯片集成NPU单元,实现“AI RAW域降噪”,通过传感器原始数据直接增强,保留更多细节。

能效比优化:低功耗设计与异构计算

图像增强的高计算量导致终端设备功耗上升,AI芯片通过异构计算架构(CPU+GPU+NPU)分工协作,实现能效比提升:

- 动态电压频率调节(DVFS):根据图像复杂度动态调整芯片工作频率,简单场景(如静态图像)降低功耗,复杂场景(如动态视频)满频运行;

- 近存计算:将计算单元靠近存储单元,减少数据搬运能耗(如AMD Instinct MI300的3D堆叠技术);

- 专用加速模块:针对特定任务设计硬件模块(如超分辨率专用单元),避免通用计算的资源浪费。

以智能手机为例,传统图像增强方案功耗约占CPU负载的30%,而AI芯片专用NPU可将功耗降低至5%以下。

泛化性提升:小样本学习与跨场景适配

实际场景中图像数据分布复杂(如不同光照、运动模糊、噪声类型),AI芯片通过“模型+数据”协同提升泛化性:

- 小样本学习:通过元学习(Meta-Learning)或迁移学习,在少量标注数据上快速适配新场景(如医疗影像中不同设备的图像风格);

- 动态模型调整:芯片支持模型在线更新,通过边缘端收集数据持续优化算法(如安防摄像头根据环境变化自动调整增强参数);

- 多任务融合:单芯片支持去噪、超分辨率、色彩校正等多任务并行处理,减少硬件冗余(如地平线征程5芯片支持8路图像同步增强)。

应用场景落地

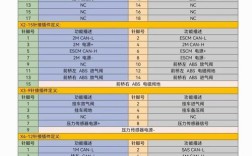

| 场景 | 技术需求 | 芯片方案案例 | 效果 |

|---|---|---|---|

| 安防监控 | 实时去噪、超分辨率、低照度增强 | 海康威视昆仑、华为昇腾310 | 夜间监控清晰度提升60%,延迟<10ms |

| 自动驾驶 | 动态去模糊、HDR融合、目标检测增强 | 特斯拉FSD、地平线征程5 | 目标识别距离提升200%,误检率降低30% |

| 医疗影像 | 去噪、对比度增强、病灶区域突出 | 英伟达Jetson Orin、寒武纪思元370 | MRI图像信噪比提升15%,病灶检出率提升25% |

| 消费电子 | 人像美颜、夜景模式、视频防抖 | 高通骁龙8系、苹果A16仿生芯片 | 夜间拍照噪点减少50%,细节保留度提升40% |

| 工业检测 | 缺陷识别、尺寸测量、表面纹理增强 | AMD Alveo、Intel Movidius | 检测效率提升5倍,缺陷识别准确率>99% |

挑战与未来方向

尽管AI芯片图像增强技术已取得显著进展,但仍面临以下挑战:

- 算法与硬件的协同深度不足:现有模型设计未充分考虑芯片硬件约束(如内存带宽、计算单元数量),导致部分算法在芯片上部署时性能下降,未来需通过“硬件感知算法设计”(如稀疏化网络、量化友好型模型)实现更优的适配。

- 端侧算力与功耗的平衡:边缘设备(如IoT摄像头)算力有限,高复杂度模型难以部署,需探索“轻量化模型+专用硬件”的极致优化方案,如存内计算(Computing-in-Memory)技术,通过存储单元直接完成计算,减少数据搬运。

- 数据安全与隐私保护:边缘端图像增强涉及用户隐私,需结合联邦学习、差分隐私等技术,在保护数据的同时优化模型。

- 跨场景泛化能力待提升:现有模型在特定场景表现优异,但面对极端环境(如强逆光、极端天气)泛化性不足,需通过多模态数据融合(如结合LiDAR数据增强摄像头图像)提升鲁棒性。

AI芯片图像增强技术将向“更智能、更高效、更普惠”方向发展:通过类脑计算、光子计算等新型硬件架构突破传统计算瓶颈;结合生成式AI(如Sora、DALL-E)实现图像的语义级增强,不仅提升画质,更理解图像内容,生成符合人类感知的优化结果。

相关问答FAQs

Q1:AI芯片图像增强与传统图像增强(如Photoshop滤镜)的核心区别是什么?

A1:传统图像增强依赖手工设计的算法规则(如高斯滤波、伽马校正),参数固定且难以适应复杂场景,需人工调整参数;而AI芯片图像增强基于深度学习模型从数据中学习特征,具备自适应能力(如自动识别不同噪声类型并选择去噪策略),同时通过芯片硬件实现实时并行处理,效率更高、效果更自然,传统方法难以处理超分辨率等复杂任务,而AI模型可学习图像的先验知识,重建更丰富的细节。

Q2:AI芯片图像增强在低光照场景下的技术难点是什么?

A2:低光照场景的技术难点主要包括:① 信号噪声比低,图像存在大量随机噪声,易导致过度降噪而丢失细节;② 光照分布不均,暗部信息缺失、亮部易过曝;③ 计算资源有限,端侧设备需在低功耗下实现实时增强,解决方案包括:通过AI模型(如Zero-DCE、LLNet)学习光照-噪声分布规律,实现自适应动态范围压缩;结合芯片的并行计算单元加速暗部细节重建;采用双曝光或多帧融合技术,在芯片端实现快速对齐与增强,平衡噪声抑制与细节保留。