Linux网络内核是操作系统的核心组件,负责管理所有网络通信活动,从数据包的接收、处理到发送,全程由内核中的网络协议栈(Network Protocol Stack)控制,这一设计继承了Unix网络模型的分层结构,确保了高效、模块化和可扩展的网络功能,内核网络栈的实现直接影响了系统的网络性能、稳定性和安全性,尤其在服务器、云计算和高并发场景下,其优化至关重要。

Linux网络内核的架构可以分为三层:协议层、设备层和接口层,协议层实现了TCP/IP协议族(如TCP、UDP、ICMP、IPv4/IPv6等),负责数据包的路由、转发和错误处理;设备层通过网卡驱动程序(如e1000、virtio-net)与硬件交互,完成数据包的收发;接口层则通过套接字接口(Socket API)为用户空间程序提供网络服务,这种分层设计使得各层可以独立开发和维护,协议层无需关心具体硬件细节,而设备层只需专注于数据包的物理传输。

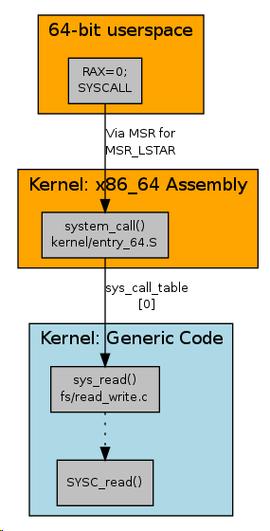

数据包在内核中的处理流程可分为接收和发送两个方向,在接收路径上,网卡接收到数据包后,通过DMA(直接内存访问)将数据复制到内核缓冲区,随后触发中断通知CPU,内核中断处理程序会调用网络协议栈,依次通过协议层(如IP层校验、TCP层重组)和设备层(如网卡队列管理),最终将数据通过套接字传递给用户空间程序,为减少中断开销,Linux采用了NAPI(New API)机制,在中断模式下快速接收一批数据包后,切换到轮询模式处理,大幅提升了高吞吐量场景下的性能,在发送路径上,用户空间程序通过write()系统调用将数据写入套接字缓冲区,内核协议栈封装协议头(如TCP头、IP头),然后通过网卡驱动将数据包发送到物理网络。

内核网络栈的性能优化技术是Linux网络高性能的关键,零拷贝(Zero-Copy)技术通过减少数据在内核空间和用户空间之间的复制次数,降低了CPU开销,常见于splice()和sendfile()系统调用;多队列网卡(Multi-Queue NIC)支持将数据包分发到不同的CPU核心处理,避免了单核瓶颈;而RPS(Receive Packet Steering)和RFS(Receive Flow Steering)则进一步优化了数据包的接收亲和性,确保同一流的数据包由同一CPU处理,提高了缓存命中率,内核还提供了流量控制(TC)和QoS(Quality of Service)功能,通过令牌桶(Token Bucket)或优先级队列(Priority Queue)等算法,实现对不同流量类型的差异化服务。

Linux内核还支持虚拟化网络技术,如Virtio-Net和SR-IOV,用于虚拟机网络通信,Virtio-Net通过半虚拟化方式,在虚拟机和主机之间共享内存和队列,减少了模拟开销;而SR-IOV则允许虚拟机直接访问物理网卡资源,接近原生性能,这些技术使得Linux成为云计算平台(如Kubernetes、OpenStack)的首选操作系统,能够高效管理大规模虚拟机网络。

网络安全方面,内核通过Netfilter框架实现了防火墙(iptables/nftables)、NAT(网络地址转换)和连接跟踪(Conntrack)等功能,Netfilter在网络协议栈的多个关键点(如 prerouting、input、forward、output、postrouting)插入钩子,允许用户自定义数据包过滤和修改规则,iptables可以通过规则链控制数据包的允许、拒绝或重定向,而nftables则提供了更高效的表和表达式语法,替代了iptables的复杂链式结构。

以下是Linux网络内核中关键模块的简要对比:

| 模块名称 | 功能描述 | 典型应用场景 |

|---|---|---|

| Netfilter | 数据包过滤、NAT、连接跟踪 | 防火墙、VPN、负载均衡 |

| e1000 | Intel网卡驱动 | 传统物理服务器网络 |

| virtio-net | 虚拟化网卡驱动 | KVM、Xen虚拟机 |

| TC (Traffic Control) | 流量整形和QoS | 网络限速、服务质量保障 |

| XFRM | IPsec协议实现 | 加密通信、VPN隧道 |

尽管Linux网络内核功能强大,但在实际使用中仍可能遇到问题,在高并发场景下,内核协议栈的锁竞争可能导致性能下降,此时可以通过调整内核参数(如net.core.somaxconn)或使用无锁数据结构(如RPS)优化,网络丢包问题可能由网卡缓冲区溢出、CPU瓶颈或路由表错误引起,需要结合ethtool、netstat和tcpdump等工具进行诊断。

相关问答FAQs:

-

如何优化Linux内核网络性能以应对高并发场景?

优化方法包括:启用多队列网卡和RPS/RFS以分散CPU负载;调整内核参数(如net.core.netdev_max_backlog增大接收队列长度);使用零拷贝技术(如sendfile)减少数据复制;部署DPDK(数据平面开发套件)绕过内核协议栈,直接在用户空间处理数据包,确保网卡驱动和内核版本最新,以利用性能修复和改进。 -

Linux内核中Netfilter和nftables的区别是什么?

Netfilter是内核框架,提供iptables等工具来管理规则,而iptables是用户空间工具,通过链(Chain)和规则(Rule)实现数据包过滤,nftables则是新一代的Netfilter用户空间接口,使用表(Table)、集合(Set)和表达式(Expression)等更灵活的数据结构,支持更高效的规则匹配和动态更新,同时兼容部分iptables语法,相比iptables,nftables性能更高,资源占用更低,且易于管理复杂规则集。