海量数据快速检测技术是当今信息技术领域应对数据爆炸式增长的核心解决方案,随着物联网、社交网络、科学计算等应用的普及,全球数据量正以每年40%以上的速度递增,传统数据处理技术在时效性、准确性和可扩展性方面面临严峻挑战,该技术通过融合分布式计算、内存计算、智能算法等创新手段,实现了对PB级甚至EB级数据的实时采集、清洗、分析与异常检测,为金融风控、工业质检、医疗诊断、公共安全等关键领域提供了高效决策支撑。

从技术架构来看,海量数据快速检测技术首先依赖于高效的数据采集与预处理层,通过分布式消息队列(如Kafka、RabbitMQ)和流式计算框架(如Flink、Spark Streaming),系统能够实时接入来自传感器、日志文件、用户行为等多源异构数据,并采用并行化处理技术完成数据清洗(去重、补全、标准化)和格式转换,在电商平台交易场景中,每秒可处理数百万条订单数据,通过分布式ETL工具将原始数据转化为结构化存储,为后续检测奠定基础,此阶段的关键技术包括数据分片(Sharding)和负载均衡,确保数据在集群节点间均匀分布,避免单点性能瓶颈。

在数据处理与存储层,列式存储(如Parquet、ORC)和内存计算(如Redis、Memcached)的显著提升了数据访问效率,相较于传统行式存储,列式存储能够按列读取,减少I/O开销,特别适合分析型场景;而内存计算则将热点数据常驻内存,使查询响应时间从秒级降至毫秒级,以Hadoop生态系统为例,HDFS分布式存储提供了高容错性的数据底层,而Hive数据仓库工具通过SQL-like查询语言实现了对海量数据的结构化分析,近年来,NewSQL数据库(如TiDB、CockroachDB)的兴起进一步融合了关系型数据库的ACID特性与分布式系统的扩展能力,支持事务级数据快速检测。

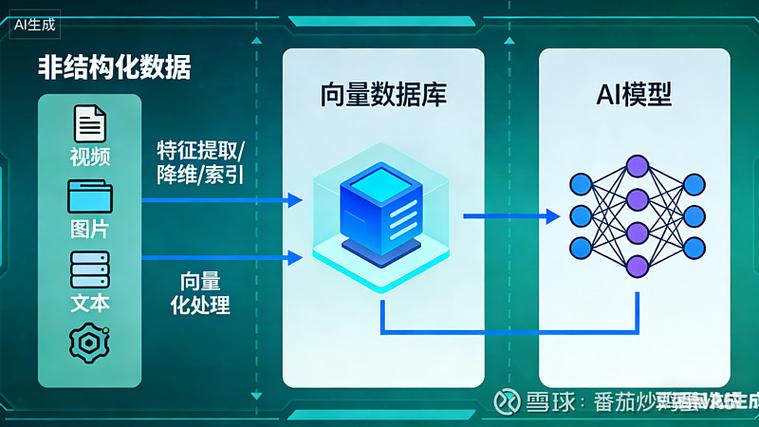

核心检测算法的优化是技术实现的关键突破点,传统机器学习算法(如决策树、SVM)在面对海量数据时存在训练效率低、特征工程复杂等问题,而基于深度学习的检测模型(如CNN、RNN、Transformer)通过分布式训练框架(如TensorFlow、PyTorch)实现了并行化参数更新,在工业质检场景中,基于卷积神经网络的图像检测模型可利用GPU集群同时处理数千张产品图片,通过迁移学习减少对标注数据的依赖,将缺陷识别准确率提升至99%以上,在线学习算法(如随机森林、在线逻辑回归)能够实时更新模型参数,适应数据动态变化特征,满足流式数据的检测需求。

实时检测引擎的构建依赖于流批一体的计算架构,Lambda架构和Kappa架构是两种主流方案,前者通过批处理层(Batch Layer)和流处理层(Speed Layer)分离实现历史数据与实时数据的协同分析,后者则统一采用流处理框架简化系统复杂度,以金融反欺诈系统为例,通过Flink流处理引擎实现每秒百万笔交易的实时风险评分,结合规则引擎(如Drools)和机器学习模型(如XGBoost)对欺诈行为进行多维度判定,响应延迟控制在100毫秒以内,图计算技术(如Neo4j、JanusGraph)在关系网络检测中展现出独特优势,通过邻接矩阵并行计算快速识别异常社交关系或资金链路。

性能优化方面,硬件加速与算法协同设计成为重要方向,FPGA(现场可编程门阵列)和GPU(图形处理器)通过定制化计算单元加速特定算法(如矩阵运算、哈希计算),使检测效率提升10-100倍,软件层面,向量化计算(如SIMD指令)和缓存优化(如LRU策略)减少了CPU资源浪费,模型压缩技术(如剪枝、量化、知识蒸馏)在保持检测精度的同时降低了计算复杂度,使轻量化模型能够部署于边缘设备,实现“端边云协同”的快速检测,在自动驾驶场景中,车载边缘计算单元通过压缩后的目标检测模型实时识别交通标志,延迟低于50毫秒。

应用场景的拓展进一步验证了技术的价值,在医疗领域,海量医学影像数据的快速检测辅助医生实现早期疾病诊断,如基于深度学习的肺结节检测系统可在10秒内完成CT图像分析,准确率媲美资深放射科医师;在智慧城市中,通过分析交通摄像头视频流实时识别交通事故与拥堵事件,信号控制响应时间缩短至3分钟以内;在网络安全领域,用户行为分析(UEBA)系统每秒处理数十亿条日志数据,精准定位异常登录和数据泄露风险,这些应用不仅提升了检测效率,更创造了显著的经济与社会效益。

尽管技术不断进步,海量数据快速检测仍面临数据质量、隐私保护、算法可解释性等挑战,噪声数据可能导致检测模型误判,联邦学习和差分隐私技术能够在保护数据隐私的同时实现协同建模;而可解释AI(XAI)方法(如LIME、SHAP)则通过特征重要性分析增强检测结果的可信度,随着量子计算、类脑计算等前沿技术的发展,海量数据快速检测技术将在智能化、自适应化方向实现新的突破,为数字经济时代的数据价值挖掘提供更强支撑。

相关问答FAQs

Q1:海量数据快速检测技术与传统数据处理技术的主要区别是什么?

A1:核心区别在于处理效率、架构模式和适用场景,传统技术多采用单机批处理模式,面对海量数据时存在扩展性差、延迟高的问题(如Hadoop MapReduce分钟级响应);而快速检测技术基于分布式架构,支持流批一体处理,延迟可降至毫秒级(如Flink实时处理),传统技术依赖人工特征工程,快速检测则通过深度学习实现端到端特征自动提取,并融合硬件加速(GPU/FPGA)提升计算效率,适用于实时风控、动态质检等高时效性场景。

Q2:如何保障海量数据快速检测过程中的数据安全与隐私?

A2:可通过技术与管理手段综合保障,技术上,采用数据脱敏(如加密、掩码)、联邦学习(数据不出本地联合建模)、差分隐私(向数据添加噪声保护个体信息)等方法,防止敏感信息泄露;管理上,建立数据分级分类制度,通过访问控制(如RBAC权限模型)和审计日志确保数据使用合规,在医疗数据检测中,联邦学习允许多家医院在不共享原始数据的情况下训练联合模型,既保障了患者隐私,又提升了检测精度。